ABD ve İsrail İran’a saldırılarda yapay zekâyı nasıl kullanıyor?

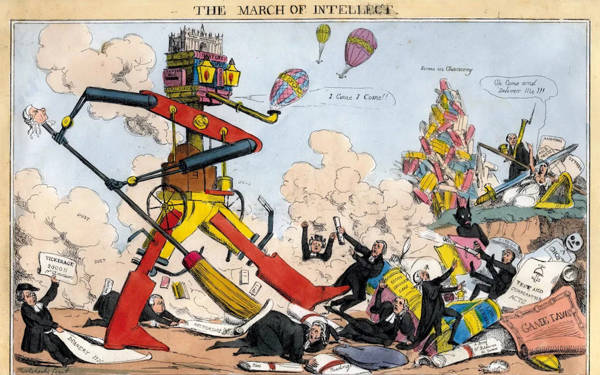

Teknoloji tekellerinin “etik” ve “iyi yapay zekâ” anlatıları, askerî-endüstriyel kompleksle kurdukları organik bağların açığa çıkmasıyla çöküyor.[1] Gündelik yaşamı kolaylaştırma iddiasıyla pazarlanan “büyük veri” sistemleri ve dil modelleri, aslında doğrudan emperyalist savaş endüstrisinin temel bir bileşeni olarak çalışıyor. Toplumsal emeğin ve kolektif bilginin mülk edinilmesiyle inşa edilen bu devasa hesaplama gücü, artık ticari bir ürün sınırlarında kalmıyor. Pentagon ve İsrail ordusuyla sağlanan yapısal entegrasyon sayesinde bu üretici güç, sömürgeci/emperyalist şiddet doktrinlerinin ve hedefleme operasyonlarının asli altyapısı hâline gelerek yıkıcı güce dönüşüyor.

ABD ve İsrail’in İran’a yönelik emperyalist saldırısı, bu sistemlerin sahadaki fiili işleyişini bütün açıklığıyla ortaya koyuyor. Karşımızdaki veri işleme gücü, saldırı aygıtına dışarıdan eklenmiş pasif bir yardımcı yazılım işlevi görmüyor. Aksine, doğrudan komuta zincirine yerleşerek istihbaratı işleyen ve hedefleme kararlarını devralan ana mekanizma olarak konumlanıyor.

Yapay Zekânın Politik İnşası

Saldırının aşamaları: Siber ağlardan ateş gücüne

İran’a yönelik saldırı dalgası, 28 Şubat 2026 gecesi ülkenin dijital ağlarına yönelik müdahalelerle başladı. ABD Genelkurmay Başkanı Dan Caine’in 2 Mart’ta basına açıkladığı operasyonel zaman çizelgesine göre, fiziksel yıkımdan saatler önce ABD Siber Komutanlığı ve Uzay Komutanlığı devreye girdi.[2] İlk füzeler hedeflerini bulmadan çok önce, İran’ın haberleşme altyapısını, radar ağlarını ve hava savunma sensörlerini işlevsiz bırakan kapsamlı bir siber saldırı düzenlendi. 1 Mart sabahına gelindiğinde, 5 milyondan fazla indirmeye sahip BadeSaba dini takvim uygulaması gibi platformlar hacklenerek ülke çapında “hesaplaşma zamanı” temalı psikolojik savaş mesajları yayıldı.[3] Amaç, İran’ın iletişim kurma ve tehlikeyi algılama kapasitesini daha ilk saniyelerde yazılımsal hamlelerle devre dışı bırakmaktı.

28 Şubat’ı 1 Mart’a bağlayan saatlerde iletişim ağı çökertildikten hemen sonra, işleyen yapay zekâ sistemleri operasyonun merkezine yerleşti. Casus uydulardan, insansız hava araçlarından (İHA), yerdeki radarlardan ve sahadaki istihbarat ajanlarından gelen milyonlarca veri noktası tek bir dijital akış hâlinde ABD Merkez Kuvvetler Komutanlığı (CENTCOM) karargâhına aktı. Project Maven ve Anthropic’in dil modelleri gibi entegre sistemler, bu devasa veri yığınını dakikalar içinde sentezledi. Sistem; hareketli nesneleri, askeri araç kümelerini, yakıt depolarını, iletişim düğümlerini ve “şüpheli” yapıları otomatik olarak haritalandırıp komuta kademesine öncelikli bir saldırı listesi sundu.[4]

Yazılımların işleminden geçen bu operasyonel liste, 1 Mart 2026 ile birlikte dakikalar içinde sahadaki ateş gücüne aktarıldı. Son aşamada savaş uçakları, seyir füzeleri ve diğer platformlar devreye sokuldu. Sadece operasyonun ilk 24 saatinde 1000’den fazla hedefin vurulmuş olması, burada yalnızca yoğun bir hava bombardımanının yaşanmadığını kanıtlıyor.[5] Karşımızdaki tablo, ateş açma ritminin çok daha hızlı ve tamamen makine mantığıyla işleyen bir hedefleme düzeni üzerinden koordine edildiğini açıkça gösteriyor.

BM İNSAN HAKLARI YÜKSEK KOMİSERİ TÜRK

“Silah sistemlerinde yapay zekânın kullanımından çok endişeliyiz”

Karar süresini daraltan yazılımsal otorite

Operasyonun ilk evresinde kurulan bu olağanüstü hızı ve teknik altyapıyı, bizzat saldırıyı yöneten komuta kademesi de doğruluyor. 11 Mart 2026 tarihinde basına yansıyan açıklamalara göre CENTCOM Komutanı Brad Cooper, ordunun savaş alanında çeşitli gelişmiş yapay zekâ araçlarını sahaya sürdüğünü ve bu araçların büyük veri yığınlarını saniyeler içinde işleyerek karar sürecini eşi görülmemiş ölçüde hızlandırdığını belirtiyor.[6] Askeri terminolojide “yok etme zinciri” olarak adlandırılan hedefi bulma, sabitleme ve vurma adımları arasındaki süre, bu yazılımlar sayesinde ciddi oranda sıkışıyor. Daha önce aylar süren uydu görüntüsü tarama ve istihbarat çözümleme mesaisi birkaç dakikaya iniyor. Hangi yapının önce vurulacağı, hangisine hangi silahın ayrılacağı veya can kaybı riskinin nasıl hesaplanacağı gibi kritik kararlar tamamen bu dijital akışın hızı içinde veriliyor. Başka bir deyişle makine, sadece bilgileri depolayan bir arşiv gibi işlemiyor; manevra seçeneklerini şekillendiriyor, ateş açma süresini kısaltıyor ve yıkım sürecini otomatikleştirerek aktif bir rol üstleniyor.

Savunma bürokrasisinin öne sürdüğü “nihai karar her zaman insanda” savunması, sahadaki hızlandırılmış işleyişte büyük ölçüde biçimsel bir güvenceye dönüşüyor. Bu düzenek, askerlerin yerini alan özerk bir robot ordusu şeklinde çalışmasa da, kararın ve inisiyatifin özünü tamamen ele geçiriyor. Çünkü ekrandaki “onay” düğmesine basan askere gelene kadar; hangi verinin öne çıkarılacağına, hangi yapının tehdit sayılacağına, hangi hareketliliğin şüpheli bulunacağına ve hangi hedefin daha önce vurulacağına otomatize sistemler çoktan karar vermiş oluyor. İnsan fail, çoğu kez önüne gelen tabloyu sorgulamadan onaylayan bürokratik bir figür rolü üstleniyor. Önüne gelen arayüz, operasyonel bağlamdan, coğrafi gerçeklikten ve tarihsel arka plandan koparılmış, sadece yazılım tarafından filtrelenmiş verilerden oluşuyor.

Komuta yapılarında makine otoritesinin bu denli belirleyici hâle gelmesi, salt bir askeri verimlilik arayışını yansıtmıyor. ABD emperyalizmi, hegemonya krizini ve gerileyen nüfuzunu, sahip olduğu teknolojik üstünlüğü eşi görülmemiş bir hızla şiddet olarak sahaya sürerek aşmaya çalışıyor. Hedef bulma ve vurma arasındaki sürenin saniyelere inmesi, emperyalist müdahalenin karşı tarafa hiçbir tepki veya savunma süresi tanımayan, mutlak bir yeryüzü tahakkümü kurma refleksine dayanıyor.

Minab İlkokulu saldırısı: Hızlanan hedeflemenin sonuçları

Operasyonel hızın artması, bürokratik itiraz süresini sıfırlıyor ve istihbaratı karşılaştırmalı olarak doğrulama imkânını ortadan kaldırıyor. Hâl böyle olunca, veri setlerindeki en ufak bir sapmanın, güncellenmemiş eski bir uydu görüntüsünün veya kodlara sızmış matematiksel bir önyargının yaratacağı sonuç son derece ağır bir boyuta ulaşıyor. Hızlandırılmış “yok etme zincirinin” yarattığı felaket ihtimalleri soyut bir senaryo olarak kalmadı. 28 Şubat 2026 tarihinde İran’ın Minab kentindeki Şeceretü’t-Tayyibe İlkokulu’na yönelik ABD saldırısı, yapay zekâ destekli sistemlerin yapısal kusurlarının en trajik örneklerinden birini oluşturuyor.[7]

Çoğunluğu çocuk olan en az 175 kişinin hayatını kaybettiği bu saldırı, hedeflerin teknik olarak nasıl belirlendiğine dair derin bir soruşturmayı zorunlu kıldı. 11 Mart 2026’da yayımlanan The New York Times destekli ön soruşturma bulgularına göre CENTCOM, bu noktayı vururken Savunma İstihbarat Ajansı’nın (DIA) veri tabanında yer alan eski ve güncellenmemiş koordinatları temel aldı. Söz konusu okul binası, daha önce İran Devrim Muhafızları Donanması’na ait bir askeri üssün parçasıydı. Ancak görsel incelemeler, bu binanın 2013 ile 2016 yılları arasında askeri alandan tel örgülerle ayrıldığını, gözetleme kulelerinin söküldüğünü, duvarlarının boyandığını ve avlusuna bir oyun alanı eklendiğini açıkça ortaya koyuyor. Fakat kapsamlı veri tabanında burası yıllar sonra bile geçerli bir “askeri hedef” olarak kodlanmaya devam ediyordu.[8]

Saldırı saati yaklaşırken, Ulusal Jeouzamsal İstihbarat Ajansı (NGA) tarafından desteklenen Project Maven (ve muhtemelen bu sisteme entegre edilen Anthropic’in Claude dil modeli) devredeydi. Sistem, sahadaki “ilgi çekici noktaları” tespit etmek için yüz binlerce görüntüyü ve metni durmaksızın tarıyordu. Askeri yetkililer, felaketin doğrudan hesaplama teknolojilerinden değil, savaşın getirdiği olağanüstü hız içinde eski verilerin personel tarafından çift kontrolden geçirilmemesinden kaynaklandığını iddia ediyor. Fakat asıl sorun tam da burada yatıyor: Sistem o kadar hızlı ve çok sayıda hedef üretiyor ki, aradaki insan unsuru sadece onay tuşuna basan işlevsiz bir aracıya dönüşüyor. Savaşın temposu arttıkça insan doğrulama süreçleri çöküyor ve güncellenmemiş birkaç satırlık veri, Tomahawk seyir füzesinin bir ilkokulu vurmasına yol açıyor. Trump yönetimi ilk günlerde saldırının sorumluluğunu muğlaklaştırmaya çalıştı; Trump da okulun İran tarafından vurulmuş olabileceğini kanıtsız biçimde öne sürse de sahada bulunan Tomahawk parçaları ve askeri soruşturma bulguları, sorumlunun doğrudan ABD ordusunun kullandığı bu hedefleme altyapısı olduğunu netleştiriyor.

NYT ön soruşturma raporuna ulaştı: İran’daki okul saldırısının sorumlusu ABD

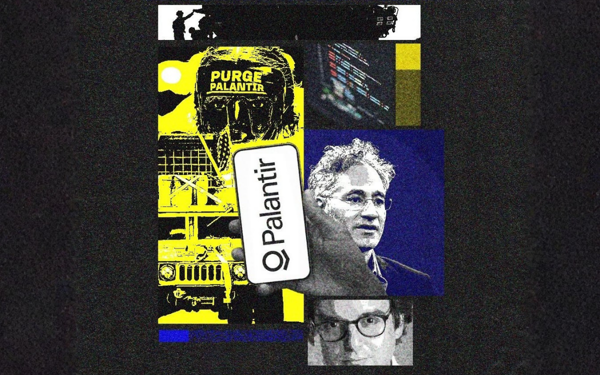

Savaşın yazılım merkezi: Palantir ve Project Maven

Bu devasa hedefleme yapısının merkezinde ise teknoloji şirketi Palantir bulunuyor. Şirketin oynadığı rol, kamuoyunda ana akım medyanın tercih ettiği şekliyle “savunma yazılımı sağlayıcısı” gibi zararsız bir ifadeyle geçiştiriliyor. Oysa sahadaki işleyiş, askeri komuta yetkisinin özel şirket teknolojilerine devredilmesini içeriyor. Palantir, sahadan akan ham veriyi hedef listesine çeviren ana platformu kuruyor. Reuters’ın gördüğü 9 Mart 2026 tarihli Steve Feinberg mektubuna göre Maven sistemi resmî bir ana program statüsüne yükseltildi.[9]

Bu karar, yazılımın artık geçici bir teknolojik deneme olmaktan çıkıp, ABD ordusunun kalıcı ve en temel karar alma araçlarından biri hâline geldiğini belgeliyor. Aynı resmî belgede Maven’ın savaş alanı verilerini ayrıştırdığı, hedefleri veriler üzerinden belirlediği ve İran’a karşı yürütülen binlerce hedefli füze saldırısında doğrudan kullanıldığı ifade ediliyor. Savaş alanını gözetleme işinin Ulusal Jeouzamsal İstihbarat Ajansı gibi geleneksel kurumlardan alınıp doğrudan Pentagon’un Baş Dijital ve Yapay Zekâ Ofisi’ne devredilmesi, yaşanan şeyin sadece kârlı bir yazılım ihalesi değil, ordunun kurumsal yapısında kapsamlı bir dönüşüm olduğunu gösteriyor.[10]

Maven sisteminin çalışma mantığı sahadaki otomasyonun ulaştığı mutlak sınırı çiziyor. Yazılım; uzaydaki casus uydulardan, havadaki drone sensörlerinden, yerdeki radarlardan ve istihbarat raporlarından gelen birbirinden farklı formatlardaki veriyi tek bir ekranda, veri füzyonu ve derin öğrenme algoritmaları üzerinden birleştiriyor. Ardından, düşman unsuru olarak kodladığı yapıları otomatik olarak etiketliyor. Mart 2026’da Palantir etkinliğinde yapılan bir gösterimde Pentagon yetkilisi, Maven’ın “Orta Doğu sahasında” hedefleme için nasıl kullanıldığını anlattı ve ısı haritaları eşliğinde sistemin hızlandırılmış değerlendirme kapasitesini sergiledi. Bu sunumlarda, eskiden onlarca analistin saatler süren mesaisini gerektiren sürecin artık saniyeler içinde halledilebildiği vurgulandı. Bütün bu gösterimler basit bir ürün reklamı olmanın ötesine geçiyor; aktif bir savaşın ortasında, tam da İran coğrafyası ateş altındayken, bir teknoloji şirketinin savaşın asli unsuru olarak kurumsallaşmasını ifade ediyor.[11]

Palantir’in işlevi sadece veri depolamakla veya arayüz sunmakla kalmıyor. Şirketin kurduğu platformun, potansiyel hedefleri görselleştirip analiz ettikten sonra, bunları kara ya da hava saldırısı için otomatik aday gösterebildiği biliniyor. Sistem; hangi uçağın havalanması gerektiğine, hangi cephanenin o coğrafi yapıda daha yüksek etki yaratacağına ve hedefe nasıl yaklaşılacağına dair askeri komutaya doğrudan taktiksel öneriler sunuyor. Yayımlanan bir sistem gösteriminde kullanıcı, bölgedeki şüpheli hareketliliğin ne olduğunu sisteme soruyor; sistem saniyeler içinde muhtemel birlik yapısını analiz ediyor, ardından alternatif harekât seçenekleri, ilerleme güzergâhları ve düşmanın iletişimini bozma adımları üretiyor. Burada yazılımın konumu yardımcı bir analiz aracı olmaktan çıkıyor; hedef önceliğini, ordunun manevra yönünü ve atılacak bombaların dağılımını belirleyen, operasyonel alanı doğrudan şekillendiren bir yapıya bürünüyor.[12]

Teknoloji şirketinin kendisini nasıl konumlandırdığı da meselenin yapısal boyutunu anlamak açısından önem taşıyor. Şirketin kendi etkinliklerinden aktarılan bilgiler, hükümetten elde edilen gelirlerin eşi görülmemiş bir hızla arttığını, ordulara teknoloji satmanın şirketin kimliğinin tam merkezine oturduğunu ve İran’daki aktif çatışmalar nedeniyle tüm yazılım ekiplerinin önceliğinin “doğrudan cephedeki birlikleri desteklemek” yönünde güncellendiğini gösteriyor. Şirketin en üst düzey teknoloji yöneticilerinden (CTO) Shyam Sankar’ın aynı zamanda ABD Kara Kuvvetleri’nde yarbay rütbesiyle görev yapması rastlantı sayılamaz. Savaş teknolojisi üreten bir şirket yöneticisinin, o teknolojiyi kullanan askeri yapının bizzat içinde yer alması; personel, şirket dili ve operasyonel önceliklerin tamamen iç içe geçtiğini ispatlıyor.[13] Sözleşme boyutunda ise rakamlar sürekli katlanıyor. Maven projesi için sadece 2024 yılında 480 milyon dolara kadar çıkan bir sözleşme imzalandı ve 2025 yılında sözleşme tavanı 1,3 milyar dolara yükseltildi. Palantir artık Pentagon’un modernizasyon sürecinde çekirdek yönetici konumunda bulunuyor.[14]

NICK SRNICEK YAZDI

Yapay zekâ şirketleri ABD’nin askerî hamlelerinin nasıl parçası oldu?

Büyük dil modellerinin cepheye sürülmesi: Anthropic ve Claude

Savaş aygıtıyla entegrasyon sürecinde insan hakları söylemleriyle öne çıkan Anthropic şirketi ile Pentagon arasında yaşanan idari tartışma, sahadaki gerçekliğin üzerini örten ideolojik bir söylem işlevi görüyor. Kamuoyunda ilk bakışta “sınırlar koyan bir teknoloji şirketi” ile “sınır tanımayan bir devlet” arasında ilkesel bir çatışma yaşanıyormuş izlenimi oluştu. Olayın aslı ise çok daha dar bir yasal çerçeveye oturuyor. Anthropic, Pentagon’un Claude adlı modelini ABD vatandaşlarına yönelik kitlesel iç gözetim ve insan onayı gerektirmeyen tam özerk silah sistemleri için kullanmasını istemedi. Pentagon bu kısıtlamayı reddetti ve 5 Mart 2026 tarihinde şirketi resmi tedarik zinciri riski ilan etti.[15]

Bu idari etiketleme ve yasaklama söylemleri, Pentagon’un İran’daki operasyonlarda Claude’u kullanmaktan vazgeçtiği anlamına gelmedi. Aksine, istihbarat analizlerinde, sahadan gelen metin verilerinin sentezlenmesinde ve operasyonel planlamalarda bu modelin cephe hattında yoğun bir şekilde kullanılmaya devam ettiği açıkça belgelendi.[16] İşin teknik derinliğine inildiğinde durum daha da netleşiyor. Claude büyük dil modeli, halihazırda Palantir’in Maven sistemi içine API’ler aracılığıyla entegre edilmiş bir vaziyette çalışıyordu. Sızan raporlara göre, Maven platformundaki çok sayıda komut ve istihbarat iş akışı doğrudan Anthropic’in kod altyapısı üzerine inşa edildi. İletişimi kesilen İranlı unsurların telsiz konuşmaları ve Farsça sızıntı metinleri, bu dil modelleri aracılığıyla anlık olarak İngilizceye çevrilip askeri özetlere dönüştürülüyordu.

Şirketin ürettiği model, savaş zincirinin dışından bağlanan bağımsız bir araştırma aracı değil, komuta mimarisinin bizzat içinde yer alan bir işlem merkezi işlevi görüyordu. Uydu görüntüsü ve radar verilerini matematiksel olarak ayrıştıran görsel katman ile sahadan gelen sızıntı raporlarını okuyup sentezleyen dil modeli, tek bir hedefleme arayüzünün içinde kaynaşıyordu. Pentagon’un yaptırım kararı sonrasında bile, Palantir’in bu kodu sistemin kalbinden söküp yerine başka bir altyapı kurmasının haftalar alacağı anlaşıldı. Bu durum, büyük dil modellerinin cephe hattındaki veriyi işlemekte ne kadar yapısal bir konuma yerleştiğini kanıtlıyor.[17]

FORENSIC ARCHITECTURE’DAN JÚLIA NUENO GUITART YAZDI

Hedef fabrikası

Sömürgeci teknoloji transferi: Filistin’den İran’a

Saniyeler içinde binlerce hedefi vuran bu teknolojilerin boşlukta ortaya çıkmadığını, belirli bir sömürgeci deneyimin ve askeri laboratuvar sürecinin ürünü olduğunu vurgulamak gerekiyor. ABD ordusunun bugün İran’da devasa ölçekte kullandığı hedefleme sistemlerinin ve otomatize komuta mantığının büyük bir kısmı, işgalci ve soykırımcı İsrail güçleri tarafından on yıllardır Filistin topraklarında ve son dönemde Lübnan’da gerçek hedefler üzerinde kanlı bir biçimde test edildi.

İsrail ordusu, Gazze operasyonlarında Habsora (The Gospel) ve Lavender gibi hedefleme sistemlerini kullanarak on binlerce kişinin yaşadığı binaları otomatik olarak işaretledi ve farklı tipte saldırılar düzenledi. İsrail askeri teknoloji endüstrisi, ürettiği gözetim ve hedefleme yazılımlarına “sahada test edilmiş” unvanını doğrudan Filistinlilerin bedenleri üzerinden kazandırdı. Filistin bu yeni nesil silahların ve veri entegrasyonlarının küresel pazara çıkmadan önce denendiği kapalı bir deney alanı olarak işlev görüyor.[18] Filistin’de insan hayatını basit bir iletişim verisine (WhatsApp grubu üyeliği, konum bilgisi vb.) indirgeyen bu sistemler, can kayıplarını matematiksel bir eşik ve maliyet hesaplaması olarak kodluyor.

Orada kurulan ve Filistinliler üzerinde denenen teknolojik altyapı, teknoloji tekellerinin bulut sözleşmeleriyle (Google ve Amazon’un yürüttüğü Nimbus Projesi gibi) birleşerek bugün ABD’nin İran operasyonlarındaki ana hedefleme mantığına dönüşüyor. İsrail, uzun yıllardır hem kendi işgalini sürdürmek için teknolojiyi bir silah olarak kullanıyor hem de bu test sahasından elde ettiği veri setlerini ve şiddet pratiklerini ABD’nin bölgesel askeri hedeflerinin hizmetine sunuyor. Teknoloji transferi, bu bağlamda doğrudan işgal deneyiminin ve sömürgeci aklın transferini simgeliyor.

MARWA FATAFTA YAZDI

Savaş için yapay zekâ: Büyük teknoloji şirketleri İsrail’in suçlarını ve işgalini güçlendiriyor

Emperyalist savaş aygıtını sökmek

ABD ve İsrail, askeri operasyonlarında teknoloji tekellerini dışarıdan yazılım sağlayan sıradan tedarikçiler olarak değil, karar alma ve komuta zincirinin ana belirleyicisi olarak kullanıyor. Project Maven üzerinden veriyi hedef bankasına çeviren sistemler savaşın çekirdek programları hâline gelirken, Claude gibi dil modelleri istihbarat katmanlarına entegre ediliyor ve Silikon Vadisi sermayesi bu büyük hesaplama yükünü üstleniyor. Üretilen kodlar ve kurulan altyapılar, söz konusu şirketleri (ve diğer büyük teknoloji tekellerini) sürecin seyircisi olmaktan çıkarıp sahadaki emperyalist müdahalenin ve yıkımın bizzat baş aktörlerinden birine dönüştürüyor.

Bu tablo karşısında, teknoloji şirketlerini “etik kurallara” uymaya çağırmak veya yapay zekâyı daha şeffaf hâle getirmeyi talep etmek, meselenin özünü ıskalamak anlamına geliyor. Şirket tüzüklerine sıkıştırılmış güvenlik protokolleri, Pentagon’un veya İsrail’in askeri hedefleri söz konusu olduğunda bir saniyede ortadan kalkıyor. Temel amacı emperyalist tahakkümü otomatikleştirmek ve hedef alınan coğrafyaları insansızlaştırarak denetim altında tutmak olan bir sistemi “insancıllaştırmanın” veya iyileştirmenin hiçbir imkânı bulunmuyor. Dünyanın dört bir yanında insanların üzerine yağan füzelerin koordinatlarını, rüzgârın hızını ve katliamın hata payını hesaplayan bir savaş makinesini birkaç satır kodla zararsız hâle getiremeyiz. Karşımızdaki görev, algoritmaları regüle etmeyi talep etmek değil; o algoritmaları var eden mülkiyet ilişkilerini ve hizmet ettikleri emperyalist savaş aygıtını kökten dönüştürecek siyasi bir itirazı örgütlemeyi gerektiriyor.

Dipnotlar:

[1] Diyar Saraçoğlu, “‘İyi yapay zekâ’ yoktur söyle onlara”, bianet, 5 Mart 2026.

[2] “Top U.S. general outlines initial timeline of U.S. military operation in Iran”, Reuters, 2 Mart 2026.

[3] A.J. Vicens, “Hackers hit Iranian apps, websites after US-Israeli strikes”, Reuters, 1 Mart 2026.

[4] “How AI is transforming how the war on Iran is being fought”, The New Arab, 18 Mart 2026.

[5] “US military confirms use of ‘advanced AI tools’ in war against Iran”, Al Jazeera, 11 Mart 2026.

[6] a.g.y.

[7] Julian E. Barnes, Eric Schmitt, Tyler Pager vd., “U.S. at Fault in Strike on School in Iran, Preliminary Inquiry Says”, The New York Times, 11 Mart 2026.

[8] a.g.y.

[9] David Jeans, “Pentagon to adopt Palantir AI as core US military system, memo says”, Reuters, 20 Mart 2026.

[10] a.g.y.

[11] Caroline Haskins, “Palantir Demos Show How the Military Could Use AI Chatbots to Generate War Plans”, WIRED, Mart 2026.

[12] a.g.y.

[13] Steven Levy, “At Palantir’s Developer Conference, AI Is Built to Win Wars”, WIRED, 21 Mart 2026.

[14] David Jeans, “Pentagon to adopt Palantir AI as core US military system, memo says”, Reuters, 20 Mart 2026.

[15] Karen Freifeld ve Deepa Seetharaman, “Pentagon designates Anthropic a supply chain risk”, Reuters, 5 Mart 2026.

[16] a.g.y.

[17] David Jeans ve Mike Stone, “Palantir faces challenge to remove Anthropic from Pentagon’s AI software”, Reuters, 4 Mart 2026.

[18] Diyar Saraçoğlu, “Loewenstein: Gazze’de yaptıklarına rağmen İsrail’e derin bir hayranlık var”, bianet, 27 Eylül 2024.

(DS/VC)

Tahakküm kurmak için inşa edildi

Üretici güçlerden imha makinesine: Palantir ve emperyalist hegemonya

Larry Lohmann: Yapay zekâ fazlasıyla dağınık ve çelişkili bir kumar

“İyi yapay zekâ” yoktur söyle onlara

ABD'de göçmen polisi ICE, altı ayda Microsoft’a bağımlılığını üç katına çıkardı

Yapay zekâ şirketleri ABD’nin askerî hamlelerinin nasıl parçası oldu?

Ya teknoloji işçileri üretimi planlarsa?

Thaura.ai: Ötekileştirilenlerin sesini bastırmak yerine merkeze alıyoruz

İşbölümü, genel zekâ ve denetim: Makine Çağı (4)

Savaş için yapay zekâ: Büyük teknoloji şirketleri İsrail’in suçlarını ve işgalini güçlendiriyor

Prosfygika günleri: Bir topluluk nasıl savunulur?

Nakba hafızasını oyuna dönüştürmek: 'Dreams on a Pillow' için yeni destek çağrısı

Üretici güçlerden imha makinesine: Palantir ve emperyalist hegemonya

Prosfygika’nın tahliyeye karşı direnişi: “Bir karış toprak bile vermeyeceğiz”

Spiros Grammenos: Hafıza silinmesin diye şarkı söylüyorum