MİLİTARİZM VE YAPAY ZEKA

“İyi yapay zekâ” yoktur söyle onlara

En baştan söyleyelim; “yapay zekâ” alanında teknoloji tekellerinin talan modeline karşı bir “direnç teknolojisi” olarak öne çıkıp ötekileştirilenlerin sesini merkeze alan Thaura gibi çabalara değil sözümüz.[1] Bizim itirazımız, sahnenin hâkim güçlerine, Silikon Vadisi’nin “parlak yıldızlarına” ve onların savaş aygıtıyla kurdukları ölümcül ittifaka. Bu yazı, bu ittifak koşullarında “iyi yapay zekâ” vaadinin bir yanılsama olduğunu öne sürüyor.

ABD ordusunun yapay zekâyı emperyalist saldırılarının doğrudan ve aktif bir bileşeni hâline getirmesiyle birlikte, 2026 yılının ilk aylarında bu alandaki tartışmalar tamamen başka bir aşamaya taşındı. Ocak ayında ABD istihbaratının Venezuela Devlet Başkanı Nicolás Maduro’yu hedef alan operasyonunda ve hemen ardından Şubat ayı sonunda İran’a yönelik kapsamlı hava saldırılarında, Pentagon’un Anthropic şirketine ait Claude yapay zekâ modelini kullandığı ortaya çıktı.[2][3] Ortadaki bu çarpıcı gerçekliğe rağmen, bugün kamuoyunda yaygın olan algı ise kâr odaklı OpenAI’ın Pentagon ile hevesle masaya oturduğu, “etik” Anthropic’in ise askeri taleplere direndiği yönünde. Nitekim Anthropic’in Şubat ayı sonunda Pentagon’un kısıtlamaları kaldırma talebini reddetmesi de bu illüzyonu iyice besledi.

TEKNOLOJİ ŞİRKETLERİ İSRAİL’İN YANINDA

‘Amazon’dan sipariş’: Teknoloji devleri İsrail’in savaşı için kitlesel verileri nasıl depoluyor?

Ancak ortadaki çelişki son derece açık: Washington’da şirket yöneticileri ile hükümet yetkilileri arasında yapay zekâ etiği üzerine hararetli tartışmalar yürütülürken ve Anthropic kâğıt üzerinde orduya “direniyor” gibi görünürken; ABD ordusu bu modelleri istihbarat verilerini sentezlemek, bombalanacak hedefleri seçmek ve savaş simülasyonları kurgulamak gibi amaçlarla sahadaki askeri ağlara çoktan entegre etmişti.

Üstelik yapay zekânın askeri ağlara entegre edildiği bu süreç yalnızca ABD ordusuyla sınırlı değil. Teknoloji tekellerinin sağladığı devasa altyapılar, İsrail’in Filistin’deki işgalini ve savaş suçlarını da yıllardır doğrudan güçlendiriyor. Google ve Amazon’un İsrail hükümetine ve ordusuna bulut hizmeti sağladığı milyar dolarlık Nimbus Projesi veya İsrail ordusunun ölümcül saldırılarında hedefleri otomatik olarak belirlemek için kullandığı Lavender ve Gospel gibi yapay zekâ sistemleri, algoritmaların sömürgeci tahakküm ve imha süreçlerindeki rolünü çoktan kanıtladı. İsrail’in imha süreçlerinin dahi ABD merkezli şirketlerin dijital altyapısına doğrudan bağımlı olması, bu teknolojilerin küresel bir tahakküm ağının ayrılmaz bir parçası olduğunu açıkça ortaya koyuyor. Yıllardır süren bu işgal ve yaşanan son saldırılar, ABD’nin emperyal güdümünde ve sermaye birikim rejiminin merkezinde yer alan yapay zekâ sistemlerinden insanlık için faydalı veya iyi bir sonuç çıkmasının yapısal olarak imkânsız olduğunu bir kez daha gösteriyor.

YUVAL ABRAHAM YAZDI

İsrail’in Google ve Amazon’la yaptığı anlaşmanın perde arkası

MARWA FATAFTA YAZDI

Savaş için yapay zekâ: Büyük teknoloji şirketleri İsrail’in suçlarını ve işgalini güçlendiriyor

Silikon Vadisi’nin militarizasyonu

Son on yılda Silikon Vadisi şirketleri, faaliyetlerini sürdürürken olası devlet regülasyonlarını savuşturmak ve aldıkları devasa yatırımları kamuoyu nezdinde meşrulaştırmak için “Etik Yapay Zekâ” kavramını agresif bir biçimde pazarladılar. Kendi içlerinde kurdukları etik kurulları ve yayınladıkları şeffaflık raporları ile teknolojinin kontrol altında olduğu yanılsamasını yarattılar. Ancak bu yazılımsal anlatıların arkasında trilyonlarca dolarlık, akıl almaz derecede enerji yoğun ve tamamen jeopolitik çıkarlara dayanan fiziksel bir altyapı yatıyor.

Teknoloji tekellerinin devletin askeri aygıtıyla giderek bütünleşmesinin nedenlerinin başında yapay zekâ modellerini eğitmek ve çalıştırmak için gereken astronomik donanım ve enerji maliyetleri yer alıyor. Serbest piyasanın tüketici odaklı gelirleri, bu devasa fiziksel altyapıyı finanse etmeye çoğunlukla yetmiyor. Pentagon ise milyarlarca dolarlık uzun vadeli savunma ihaleleri ile bu şirketlere “can suyu” sağlıyor, karşılığında da şirketlerin geliştirdiği modelleri “tüm yasal amaçlar” kılıfı altında kısıtlamasız kullanıma açmasını talep ediyor. ABD’nin buradaki yasal vurgusu, evrensel hukuku değil, emperyalist devletin küresel çıkarları uğruna sınırlarını dilediği gibi esnetebildiği olağanüstü hâl rejimini temsil ediyor. İkili kullanıma sahip bir teknoloji devletin envanterine girdiğinde, kullanım alanı ABD’nin emperyalist hedefleri doğrultusunda kaçınılmaz olarak genişliyor. Şirketlerin tüketiciye sunduğu şık kullanım sözleşmeleri, “ulusal güvenlik” doktrinleri karşısında hiçbir hüküm ifade etmiyor.

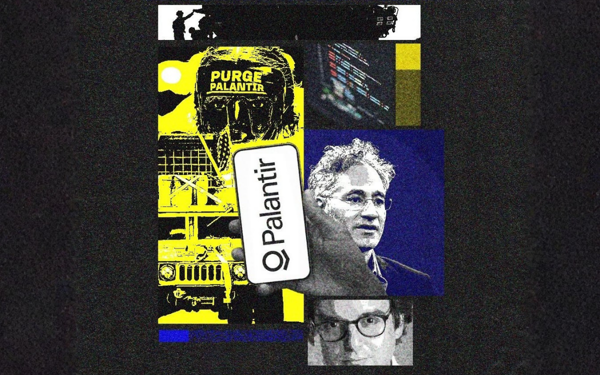

Üstelik bu entegrasyon sadece yazılım lisanslarıyla veya veri satmakla sınırlı kalmıyor. Silikon Vadisi’nin geleneksel aktörleri; modern askeri istihbaratın veri omurgasını oluşturan Palantir veya doğrudan otonom savaş sistemleri ve insansız araçlar üreten Anduril gibi yeni nesil şirketlerle yapısal bir ortaklık kurarak savaş endüstrisinin ayrılmaz bir parçası hâline geliyor.

Sermaye ve savunma sanayisinin bu denli iç içe geçmesi, aslında yeni bir teknolojik sapma değil; ABD emperyalizminin veri ve gözetimle kurduğu tarihsel tahakkümün doğrudan bir devamı. ABD ordusu, veriyi bir “işgal enstrümanı” olarak kullanmaya çok daha erken dönemlerde başlamıştı. 1899’daki Filipinler işgali sırasında direnişi pasifize etmek amacıyla yerel liderlerin finansal kaynaklarını, mülklerini, siyasi sadakatlerini ve akrabalık ağlarını haritalandıran kapsamlı veri setleri oluşturulmuştu. Yıllar sonra ABD’nin Vietnam’ı işgali sırasında yürütülen “Igloo White” operasyonunda ise geniş bir alanın sensörlerle izlenmesi mantığı devreye sokuldu. Sensörlerden gelen verilerin toplanması, sınıflandırılması ve doğrudan saldırı kararlarına aktarılması, hedefleme sürecini bugünküne benzer şekilde giderek daha otomatik bir işleyişe yaklaştırdı. Dolayısıyla bugün Pentagon’un “bulut hizmetleri” ve büyük dil modelleri aracılığıyla yürüttüğü operasyonlar, Filipinler’de defterlerle ve Vietnam’da sensörlerle başlatılan sömürgeci denetim ve imha mantığının en güncel algoritmik eşiğinden ibarettir.

Açık kaynaktan savaş aygıtına: OpenAI

Yapay zekânın militarizasyon sürecini ve sermaye ile olan organik bağını anlamak için alanın öne çıkan ismi OpenAI’ın geçirdiği tarihsel evrim mutlaka incelenmeli. OpenAI, 2015 yılında kurulduğunda yapay zekânın kâr amacıyla tekelleşmesini engellemeyi, teknolojiyi açık kaynaklı tutmayı ve insanlığın evrensel faydası için çalışmayı amaçlayan kâr amacı gütmeyen bir araştırma kurumu olarak yola çıkmıştı. Bugün ise aynı OpenAI, Pentagon’un en gizli, sınıflandırılmış askeri ağlarına doğrudan yapay zekâ altyapısı sağlamak üzere yaptığı resmi anlaşmaları Amerikan kamuoyuna duyuruyor.

Bu radikal dönüşüm, yalnızca şirket yöneticilerinin ahlaki zaaflarıyla açıklanamaz. Bir önceki bölümde bahsettiğimiz o devasa fiziksel donanım maliyetleri, OpenAI’ı daha 2019 yılında açık kaynak ideallerinden vazgeçirerek “kâr tavanlı” hibrit bir yapı kurmaya ve Microsoft gibi tekellerden milyarlarca dolar yatırım almaya itmişti. Açık kaynak vizyonu yerini ticari sırlara bırakırken; beklenen o devasa kâr oranlarını tutturmak ve operasyonel giderleri karşılamak için en büyük müşteri olan güvenlik aygıtıyla bütünleşmek artık yapısal olarak kaçınılmaz bir zorunluluktu.

Militarizasyona giden bu yoldaki ilk somut adım, Ocak 2024’te atıldı. OpenAI, görünür hiçbir dış baskı olmaksızın, şirket tüzüğünde yer alan ve teknolojisinin “askeri amaçlarla” kullanımını kesin bir dille yasaklayan o meşhur maddeyi sessizce kaldırdı. Bu kritik politika değişikliğinin hemen ardından şirket, Pentagon ile siber güvenlik gibi kulağa daha masum ve “savunma odaklı” gelen projelerde çalışmaya başladığını sızdırdı.[4] Bu taktik, toplumu militarizasyona yavaş yavaş alıştırmak için kullanılan bilindik bir yöntemdi. Süreç tam da bu “normalleştirme” stratejisine uygun şekilde ilerledi.

Şirket asıl büyük sıçramayı ise 2026 yılındaki siyasi krizi fırsata çevirerek yaptı. OpenAI, en büyük rakiplerinden Anthropic’in Pentagon ile yaşadığı kısıtlama krizinden ve Trump yönetiminden yediği ambargodan derhâl yararlanarak sahadaki boşluğu doldurdu. 28 Şubat 2026 tarihinde Sam Altman, X platformu üzerinden Pentagon ile yapılan yeni ve çok daha kapsamlı bir askeri entegrasyon anlaşmasını aceleyle duyurdu:

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network.

— Sam Altman (@sama) February 28, 2026

In all of our interactions, the DoW displayed a deep respect for safety and a desire to partner to achieve the best possible outcome.

AI safety and wide distribution of…

Ancak bu “fırsatçı” duyuru beklenenin ötesinde yoğun bir tepki toplayınca, Altman yine X üzerinden iç yazışmalarını kamuoyuyla paylaşarak geri adım atıyormuş gibi görünen ikinci bir açıklama yayımlamak zorunda kaldı.

Here is re-post of an internal post:

— Sam Altman (@sama) March 3, 2026

We have been working with the DoW to make some additions in our agreement to make our principles very clear.

1. We are going to amend our deal to add this language, in addition to everything else:

"• Consistent with applicable laws,…

Altman bu yeni açıklamasında; Savunma Bakanlığı ile yapılan anlaşmaya, ABD anayasasına atıf yapılarak modellerin “ABD vatandaşlarının yurt içi gözetiminde kasten kullanılmayacağına” ve “Ulusal Güvenlik Ajansı (NSA) gibi istihbarat kurumlarınca şimdilik doğrudan kullanılmayacağına” dair güvence maddeleri eklendiğini savundu. Anayasa dışı bir emir alırsa “hapse girmeyi tercih edeceğini” iddia eden Altman, ilk anlaşmanın duyurulma biçiminin de “fırsatçı ve özensiz” göründüğünü itiraf etti. Fakat bu şeffaflık sosuna bulanmış halkla ilişkiler manevrası, devasa teknoloji şirketinin milyarlarca dolarlık ihaleler karşılığında askeri karar alma mekanizmalarının temel bir parçası hâline geldiği gerçeğini zerre kadar değiştirmiyor. Kâr odaklı sermaye birikiminin kendi mantığı, sözümona insanlığın evrensel faydası için atılan o kurucu idealleri çoktan tasfiye etmiş durumda.

Anayasal yapay zekânın çöküşü: Anthropic

Militarizasyon sürecindeki en çarpıcı örneklerden birini de Anthropic şirketinin yaşadığı kriz oluşturuyor. Anthropic, OpenAI’ın kâr odaklı dönüşümüne ve güvenlik ihmallerine tepki gösteren bir grup araştırmacı tarafından 2021 yılında kurulmuştu. Şirket, yapay zekânın insanlık için “güvenilir ve yönlendirilebilir” olmasını sağlama iddiasıyla yola çıktı. Kurucuları, kâr hırsının önüne her zaman etik ilkeleri koyduklarını öne sürdüler. Bu doğrultuda Anthropic, model çıktılarını Birleşmiş Milletler İnsan Hakları Evrensel Beyannamesi gibi temel metinlere dayandırarak sınırlamayı vadeden “Anayasal Yapay Zekâ” yaklaşımını geliştirdi ve tüm marka değerini bu duruş üzerine inşa etti. Ancak askeri endüstriyel kompleksin ihtiyaçları söz konusu olduğunda, şirketlerin kendi kendilerine yazdıkları anayasaların hiçbir geçerliliği olmadığı hızla ortaya çıktı.

Anthropic, 2026 yılının Şubat ayı sonlarında Pentagon’un otonom hedefleme ve ABD sınırları içinde vatandaşlara yönelik kitlesel gözetimi engelleyen teknik kısıtlamaların tamamen kaldırılması yönündeki resmi talebini reddetti. Tabii burada bir parantez açmak gerekiyor; Anthropic bu talebi reddederken bile metnini şöyle bitiriyordu: “Amerika Birleşik Devletleri’nin ulusal güvenliğini desteklemek için çalışmalarımızı sürdürmeye hazırız”.[5] Şirketin açık kapı bırakan bu tavrına rağmen kısıtlamaları esnetmeyi nihayetinde reddetmesi üzerine, devlet mekanizması tüm ağırlığıyla devreye girdi. Savunma Bakanı Pete Hegseth, Anthropic CEO’su Dario Amodei’ye kesin bir ültimatom vererek şirketin geliştirdiği modellerin “tüm yasal amaçlar” adı altında ordu tarafından kısıtlamasız kullanıma açılmasını emretti. Anthropic kendi kurumsal güvenlik politikalarını gerekçe gösterip bu talebe direndiğinde; Trump yönetimi Şubat ayının son haftasında derhal tüm federal kurumların şirketin ürünlerini kullanımını yasakladı ve Pentagon, Anthropic’i resmi olarak bir tedarik zinciri riski ilan ederek devasa kamu ihalelerinden men etti.[6]

Aynı günlerde Pentagon, doğrudan ABD başkanına özel şirketlerin üretim süreçlerine ulusal güvenlik gerekçesiyle müdahale etme yetkisi veren Soğuk Savaş dönemi yasası Savunma Üretim Yasası’nı devreye sokmakla tehdit etti. Siyasi irade Anthropic’i kâğıt üzerinde federal sistemlerden yasaklayıp kurumsal olarak boğmaya çalışırken, perde arkasında şirketin en gelişmiş modeli olan Claude’u İran’ı vuran bombardıman uçaklarının koordinasyonunda ve Venezuela’daki gizli operasyonlarda Palantir yazılımının altyapısı üzerinden fiilen kullanmaya devam etti.[7][8]

Yapay zekâyı değil düzeni değiştirmek

ABD’nin İran’a yönelik kapsamlı hava bombardımanlarında yapay zekâ kullanması, Venezuela’daki istihbarat operasyonlarının algoritmalarla yönlendirilmesi ve Silikon Vadisi’nin artan maliyetlerle birlikte tamamen savaş aygıtına teslim olması; kapitalist sistemin mevcut krizinin ve ABD emperyalizminin küresel hegemonyasını koruma refleksinin yapısal birer sonucu olarak karşımıza çıkıyor.

Dijital altyapının topyekûn militarizasyonu, sivil bir alan olarak pazarlanan bilişim altyapısının ve veri merkezlerinin artık savaşın doğrudan fiziksel bir cephesi hâline geldiğini kanıtlıyor. 2 Mart 2026’da Birleşik Arap Emirlikleri (BAE) sınırları içindeki Amazon Web Services (AWS) veri merkezi kompleksinin drone saldırılarıyla hedef alınması, bu yeni dönemin en somut örneği. ABD’nin İran’a yönelik saldırılarında Claude modellerini kullanmasına bir misilleme olarak da gerçekleştiği düşünülen bu saldırı, “hesaplama gücü”nün artık petrol rafinerileri kadar stratejik bir askeri hedef olduğunu doğruluyor.

Savaşın, yıkımın ve gözetimin algoritmalar üzerinden normalleştirildiği bu tablo ne kadar karamsar görünürse görünsün, Silikon Vadisi ve Pentagon’un dayattığı bu geleceğe mahkûm değiliz. Karşımızdaki asıl mesele, şirketlerin pazarladığı “iyi yapay zekâ” illüzyonuyla oyalanmak değil; teknoloji kılığına girmiş bu emperyalist tahakküme karşı net bir politik itiraz yükseltmektir. Zira yapay zekâyı sermayeden ve savaş aygıtından geri kazanmak, sadece daha “adil” çalışan algoritmalar talep etmekle mümkün olamaz. Teknik kapasiteyi ve hesaplama gücünü emperyalist önceliklerden koparıp kamusal yararı önceleyen bir yapıya devretmek gerekiyor. Yapay zekâ modelinin üzerinde çalıştığı donanım altyapısı Pentagon bütçesiyle finanse ediliyorsa, o modelin beslendiği veriler istihbarat ağlarından geliyorsa ve ürettiği analitik çıktılar askeri karargâhlara aktarılıyorsa; şirket tüzüklerinde yazan etik kurallar hiçbir anlam ifade etmez.

Teknoloji şirketlerinin ve büyük sermayenin emperyalist savaş, küresel gözetim ve “güvenlik” mimarisine geri dönüşsüz bir şekilde bağlandığı bu düzende, dünyanın dört bir yanında ezilenlerin üzerine yağan bombaların koordinatlarını hesaplayan bir yapay zekânın iyi olma ihtimali bulunmuyor. Gerçek anlamda “iyi” bir yapay zekâ, ancak bu devasa üretici gücü tekelinde tutan kapitalist üretim ilişkilerinin aşılması ve emperyalist savaş aygıtının kökten tasfiyesiyle mümkün olabilir.

Dipnotlar:

[1] Diyar Saraçoğlu, “Thaura.ai: Ötekileştirilenlerin sesini bastırmak yerine merkeze alıyoruz”, bianet, 22 Aralık 2025,

[2] Amrith Ramkumar Follow, Keach Hagey Follow, Vera Bergengruen Follow, “Pentagon used Anthropic’s Claude in Maduro Venezuela raid”, The Wall Street Journal, 15 Şubat 2026,

[3] Ed Pilkington, “Claude-Anthropic Iran strikes US military”, The Guardian, 1 Mart 2026,

[4] Nick Srnicek, “Yapay zekâ şirketleri ABD’nin askerî hamlelerinin nasıl parçası oldu?”, çev. Diyar Saraçoğlu, bianet, 22 Ocak 2026,

[5] “Statement on the Department of War”, Anthropic, 26 Şubat 2026,

[6] Justin Hendrix, “A Timeline of the Anthropic Pentagon Dispute”, Tech Policy Press, 25 Şubat 2026,

[7] “US used Anthropic’s Claude during the Venezuela raid, WSJ reports”, Reuters, 14 Şubat 2026,

[8] “US uses Anthropic AI, B-2 bombers and suicide drones in Iran strikes”, Reuters, 1 Mart 2026,

(DS/Mİ)

Tahakküm kurmak için inşa edildi

Üretici güçlerden imha makinesine: Palantir ve emperyalist hegemonya

ABD ve İsrail İran’a saldırılarda yapay zekâyı nasıl kullanıyor?

Larry Lohmann: Yapay zekâ fazlasıyla dağınık ve çelişkili bir kumar

ABD'de göçmen polisi ICE, altı ayda Microsoft’a bağımlılığını üç katına çıkardı

Yapay zekâ şirketleri ABD’nin askerî hamlelerinin nasıl parçası oldu?

Ya teknoloji işçileri üretimi planlarsa?

Thaura.ai: Ötekileştirilenlerin sesini bastırmak yerine merkeze alıyoruz

İşbölümü, genel zekâ ve denetim: Makine Çağı (4)

Savaş için yapay zekâ: Büyük teknoloji şirketleri İsrail’in suçlarını ve işgalini güçlendiriyor

Prosfygika günleri: Bir topluluk nasıl savunulur?

Nakba hafızasını oyuna dönüştürmek: 'Dreams on a Pillow' için yeni destek çağrısı

Üretici güçlerden imha makinesine: Palantir ve emperyalist hegemonya

Prosfygika’nın tahliyeye karşı direnişi: “Bir karış toprak bile vermeyeceğiz”

Spiros Grammenos: Hafıza silinmesin diye şarkı söylüyorum