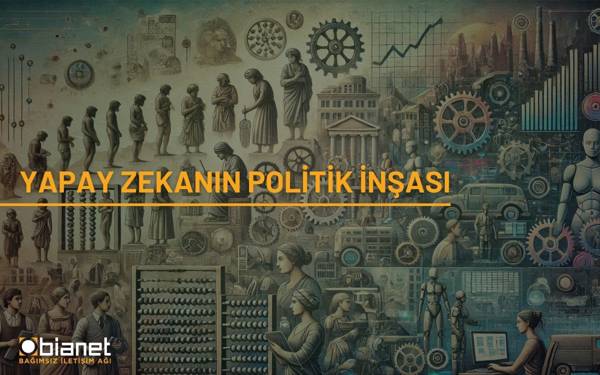

Thaura.ai: Ötekileştirilenlerin sesini bastırmak yerine merkeze alıyoruz

Yapay Zekânın Politik İnşası dosyamızın bu bölümünde, Tech For Palestine ekosisteminden çıkan yapay zekâ aracı Thaura.ai ekibinden Hani Chihabi ile konuşuyoruz. Hani, “etik yapay zekâ” söyleminin büyük şirketlerin PR malzemesine dönüştüğü bir dönemde Thaura ile tersine bir hat kurduklarını söylüyor. Filistin’le dayanışmayı, ordu ve gözetim kurumlarıyla çalışmamayı ve kullanıcı verisiyle eğitim yapmamayı bu hattın temel ilkeleri olarak öne çıkarıyor.

Söyleşide basit bir sorunun peşindeyiz: Gözetim, sansür ve veri talanı üzerine kurulu “Büyük Teknoloji” düzenine karşı bir alternatif gerçekten mümkün mü? Thaura, insanların verisini modele dönüştüren platformların aksine “veri sende kalır” vaadini öne çıkarıyor. Hassas başlıklarda gerçeği sulandırmayan, ötekileştirilen sesleri güçlendiren, toplulukla birlikte inşa edilen bir araç iddiasını sınırlarıyla birlikte konuşuyoruz.

Yapay Zekânın Politik İnşası

“Verinizi toplamıyor, sizi izlemiyoruz”

“Thaura” (Arapça “devrim”) ismi başlı başına bir iddia taşıyor. Bugün “etik yapay zekâ” büyük şirketlerin PR söyleminin parçası hâline gelmişken, siz ilkeleriniz arasında “ordu ya da gözetim kurumlarıyla asla çalışmayız” ve “ezilenlerle dayanışma içindeyiz, dijital sömürgeciliğe karşıyız” diyorsunuz. Thaura’yı bu tabloya karşı nasıl konumlandırıyorsunuz? Büyük teknoloji şirketlerinden temel farkınızı nasıl anlatırsınız?

Thaura, Büyük Teknoloji’nin talan temelli ekstraktivist modeline karşı bir direnç teknolojisi olarak konumlanıyor. Google, Amazon ve Microsoft gibi şirketler PR için “etik yapay zekâ”dan söz ederken pratikte askeri sözleşmelerle ve gözetimle iç içe çalışıyorlar. Biz bunların hiçbirine el sürmüyoruz. Baskıcı sistemlere karşı olduğumuz için adımızı “Devrim” anlamına gelen Thaura koyduk.

Bizi farklı kılan şeyleri ise şöyle sıralayabiliriz:

- Verinizi toplamıyor, sizi izlemiyoruz.

- Siyasi bir önyargıyı dayatmıyoruz, hassas konularda gerçeği sulandırmıyoruz.

- Ötekileştirilenlerin sesini bastırmak yerine merkeze alıyoruz.

- Enerji verimliliğini önceleyen bir yaklaşım benimsiyoruz.

Etik çerçevemiz, bizi Büyük Teknoloji’nin kâr odaklı yaklaşımından net biçimde ayrıştırıyor.

“Odağımız, etik sınırlar ve filtreler kurmak”

“Yapay Zekânın Politik İnşası” serimizde, yapay zekâyı sermayenin kolektif bilgiye ve emeğe el koyma sürecinin yeni bir biçimi olarak tartışıyoruz. Büyük dil modelleri, internetteki veriyi “açık maden” gibi kullanıp çitliyor. Siz modellerinizi eğitirken bu “dijital çitleme”ye karşı nasıl bir yol izliyorsunuz? Veri setlerinizde rıza, telif ve emeğin hakkı konusunda somut olarak nasıl bir prosedür işletiyorsunuz?

Biz küçük bir ekibiz ve finansal kaynaklarımız yeterli olmadığı için kendi modelimizi eğitmedik. Bunun yerine, açık kaynak ve açık ağırlıklı bir model olan GLM 4.5 Air’den yararlanıyoruz ve onun üzerine, etik çerçevemize göre düşünmesini ve hareket etmesini sağlayan güvenlik sınırları yerleştiriyoruz. Bu yaklaşım, kolektif bilgiyi daha da kapatan yeni bir özel mülkiyet modeli üretmek yerine, mevcut açık teknolojilerle çalışarak “dijital çitleme” meselesinde daha dikkatli bir pozisyon almamızı sağlıyor.

Açık kaynak bir model kullandığımız için, internet verisini “açık maden” diye görüp çevirerek metalaştırma gibi sorunlu bir pratiğe girmemiş oluyoruz. Modelin ağırlıkları zaten kamuya açık, yani bizim kullanımımız üzerinden kolektif bilginin ya da emeğin yeni bir “ekstraktivizm”i gerçekleşmiyor. Bizim odağımız, teknolojinin dayanışma ve adalet ilkelerine uygun işlemesini güvence altına alacak etik sınırlar ve filtreler kurmak.

İleride büyüyüp kendi modellerimizi eğitebilecek duruma geldiğimizde bunu doğru şekilde, sanatçılardan izin isteyerek ve çalışmalarının karşılığını adil biçimde ödeyerek yapacağız. Şimdilik hedefimiz, piyasadakinden daha iyisini kurmak; mevcut açık teknolojileri kurumsal çıkarlara değil, etik amaçlara hizmet ettirmek.

“İnsanları Büyük Teknoloji’den özgürleşmeye teşvik ediyoruz”

Büyük teknoloji şirketleri sadece modelleri değil; sunucudan çipe, ödeme sistemlerinden buluta kadar tüm altyapıyı da kontrol ediyor. “Alternatif” bir araç kurmaya çalışırken bu altyapısal bağımlılıkla nerede duvara tosladınız? Hangi alanlarda görece bir “dijital egemenlik” sağlayabildiniz, hangi noktalarda şimdilik Amazon, Google veya NVIDIA gibi aktörlerin altyapılarına mecbur kalıyorsunuz?

Hiçbir büyük teknoloji şirketine bağımlı değiliz. Mevcut kaynak düzeyimizle bile altyapımız Azure, GCP, AWS ya da NVIDIA’ya dayanmıyor. Böyle bir teknolojiyi inşa etmek için ille de Büyük Teknoloji’ye yaslanmak zorunda olduğunuz bir dünyada yaşamıyoruz. “Tech For Palestine”ın varlık nedeni de bu; insanları Büyük Teknoloji’den özgürleşmeye teşvik ediyoruz, çünkü gerçekten de onlara bağımlı olmak zorunda değilsiniz.

Kendi altyapımız henüz yok, ama Büyük Teknoloji devlerine bağımlı olmayan ve kendi altyapısını işleten ortaklar bulduk. Taahhüdümüz bu bağımsızlığı korumak ve teknoloji alanına hükmeden talancı, baskıcı sistemlerden bizi azade tutacak altyapılar geliştirmeyi sürdürmek.

Bu yaklaşım, daha geniş misyonumuzun bir parçası: Teknolojinin farklı bir şekilde Büyük Teknoloji altyapısını karakterize eden gözetim, askeri bağlar ve sömürgeci mantık olmadan kurulabileceğini göstermek.

“Thaura, diğerlerine kıyasla yüzde 93 daha verimli”

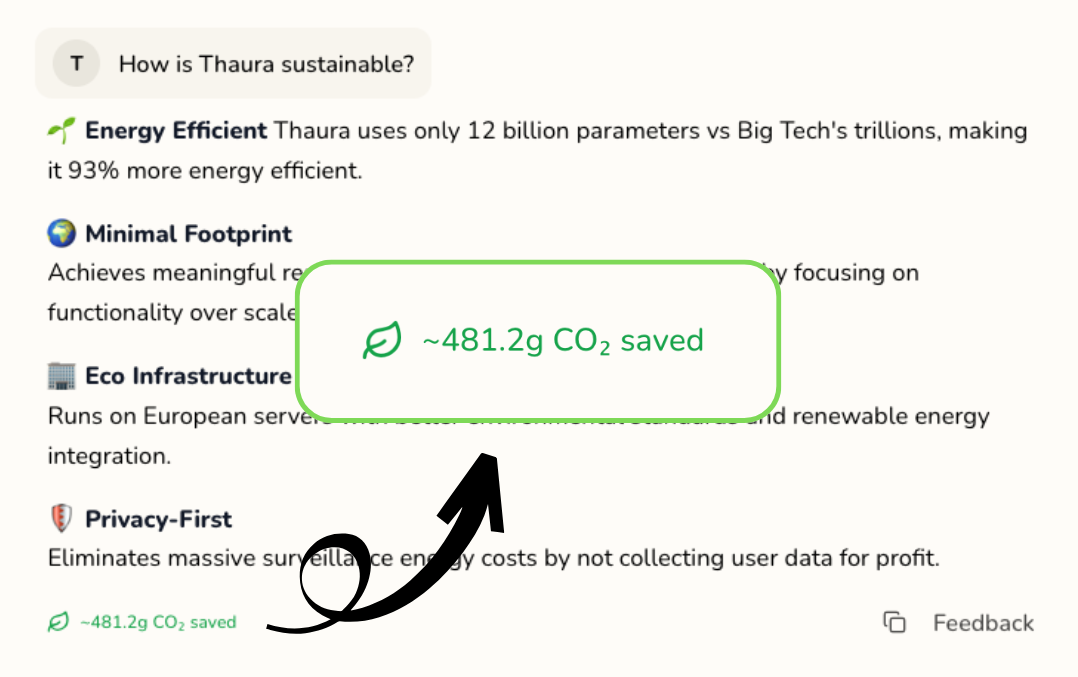

Yapay zekâ araçları bugün “bulut” metaforunun arkasına saklanarak gezegenin su ve enerji kaynaklarını sömürgeci bir mantıkla tüketiyor. Siz ilkelerinizde “iklim krizi aynı zamanda bir adalet krizi, karbon ayak izimizi en aza indirmeye çalışıyoruz” diyorsunuz ve mevcut sistemlere kıyasla çok daha az enerji kullandığınızı vurguluyorsunuz. Bu tablo karşısında sizin bu “küçülme” ve verimlilik ısrarınız ne anlama geliyor?

Thaura modelimiz Büyük Teknoloji’nin yapay zekâlarına kıyasla çok daha küçük. 100 milyar parametreye sahip ancak bunların yalnızca 12 milyarı aynı anda etkinleşiyor. Bunun nedeni, bunun bir “uzmanlar karışımı” modeli olması. Kullanıcının sorgusuna göre hangi “uzmanı” devreye alacağını akıllıca belirliyor. Buna karşılık OpenAI’nin GPT-5 modeli tahminen 3-5 trilyon parametreye sahip ve bunların tamamı aynı anda etkinleşiyor. “Merhaba” gibi basit bir istemde bile sinir ağlarının tümü bir anda devreye giriyor.

Şunu hayal edin: Size “Her şey nasıl gidiyor?” diye soruluyor ve siz, kelimenin tam anlamıyla her şeyi işlemek için çocukluğunuzdaki anılardan şu an olup bitene kadar beyninizin tamamını bir anda devreye sokuyorsunuz.

Sürdürülebilirlik ölçümlerimiz, Thaura’nın Büyük Teknoloji yapay zekâlarına kıyasla yüzde 93 daha verimli olduğunu gösteriyor. Bu verimlilik yalnızca teknik değil aynı zamanda politik de. Karbon ayak izimizi asgariye indirerek, gezegeni sonsuz bir çıkarım kaynağı gibi gören zihniyeti reddediyoruz.

“Verileri hiçbir üçüncü tarafla paylaşmıyoruz”

İlkeleriniz arasında “verinizle asla eğitim yapmayız, mahremiyet bir özellik değil temel bir haktır” ifadesi var. Bu çerçevede, özellikle eylemciler ve gazeteciler gibi risk altındaki kullanıcıların verilerini pratikte nasıl koruyorsunuz? “Veriyi eğitime katmama” ilkesinin yanında, şifreleme, log tutma politikası, sunucu altyapısı ve üçüncü taraflarla veri paylaşımı gibi konularda ne tür teknik ve kurumsal güvenceleriniz var?

Teknik olarak tüm veriler için askeri standartlarda şifreleme kullanıyoruz. Bu koruma hem aktarım sırasında hem de depolama sırasında geçerli. Yani bilgi, kullanıcı ile sunucularımız arasında taşınırken de korunuyor, sistemimizde saklanırken de korunuyor.

Kurumsal olarak verileri hiçbir üçüncü tarafla paylaşmıyoruz. Hiçbir devlet kurumu, şirket ya da başka bir yapı kullanıcı bilgilerine erişemez. Bizce veri kullanıcılara aittir. Biz yalnızca Thaura’nın çalışması için veriyi saklarız ve onu koruruz.

Büyük Teknoloji şirketleri kullanıcı verisini toplar ve gelir modeline çevirir. Biz ise mahremiyeti kâr için ya da siyasi baskı nedeniyle esnetilemeyecek mutlak bir hak olarak görüyoruz.

“İşgale katkı sunan hiçbir teknolojinin parçası olmayacağız”

“Ezilenlerle dayanışma içindeyiz, dijital sömürgeciliğe ve teknoloji destekli baskıya karşıyız” diyorsunuz. “Filistin İçin Teknoloji” ekosisteminin bir parçası olan Thaura açısından, Filistin’in uzun süredir askeri teknolojiler ve gözetim sistemleri için bir laboratuvar olarak kullanılmasını nasıl görüyorsunuz? Thaura’yı tasarlarken bu deneyim, “büyük teknolojiye karşı bir teknoloji” kurma iddianıza nasıl yansıdı?

On yıllardır Filistin, ne yazık ki askeri teknolojiler ile gözetim teknolojileri için bir deneme sahası oldu. İsrailli şirketler, gözetim ve askeri ekipmanlarını Filistinliler üzerinde geliştirip test etti; ardından bu sistemleri dünyaya ihraç etti.

Bu gerçeklik, Büyük Teknoloji’ye karşı “karşı-teknoloji” inşa etme iddiamızı doğrudan belirliyor. Google, Amazon ve Microsoft gibi şirketler bu gözetim ve savaş makinesini ayakta tutan bulut altyapısını ve yapay zekâ sistemlerini sağlarken, Thaura doğrudan bir direniş olarak var oluyor. İşgale ya da baskıya katkı sunan hiçbir teknolojinin parçası olmayacağız; buna hiçbir biçimde aracılık etmeyeceğiz.

Bizim karşı-teknoloji yaklaşımımız; askeri ya da gözetimle bağlantılı şirketlerle ortaklıkları reddetmek, sömürücü ve sömürgeci bir mantığa dayanmayan altyapılar kurmak, güçlülerin susturmaya çalıştığı Filistinli sesleri merkeze almak demek. Biz, baskıya değil dayanışmaya hizmet eden bir teknoloji kuruyoruz. Filistin’i deneme sahası yapan sistemlerin yerine geçecek alternatifler üretiyoruz.

“İnsanlar öldürülürken ‘tarafsızmış’ gibi davranmayacağız”

Popüler olan çoğu yapay zekâ aracı “bireysel üretkenlik” söylemiyle pazarlanıyor. Siz Thaura’yı kolektif örgütlenme ve toplumsal hareketler açısından nasıl konumlandırıyorsunuz? Örneğin sendikalar, öğrenci hareketleri, feminist kolektifler veya dayanışma ağları ile ne tür ortak projeler ya da kullanımlar hayal ediyorsunuz?

Şirketlere ait yapay zekâ araçlarından farklı olarak Thaura’yı toplulukla birlikte kuruyoruz. Sadece onlar için bir araç yapmıyoruz. Bu araçları gerçekten kullananların, nasıl üretildikleri ve kim tarafından kontrol edildikleri konusunda söz hakkı olmalı.

Ötekileştirilenlerin seslerinin algoritmalarla sürekli susturulduğu ve şirket gündemlerinin öne itildiği bir dünyada Thaura, hakikatin ve adaletin nefes alabileceği bir alan. Hassas konuları yumuşatmaz. Büyük Teknoloji yapay zekâ platformlarının kaçındığı tartışmalardan da geri durmaz. Biz tarafgir değiliz. Olanı olduğu gibi söylüyoruz.

Filistinlilerin bugün yaşadıkları, hayatımız boyunca tanık olduğumuz en ağır insan hakları krizlerinden biri. İnsanlar öldürülürken “tarafsızmış” gibi davranmayacağız. Bunu pratikte de gördük. Eski bir TRT stratejisti, Filistin hakkında artık sansürlenmeden yazabildiğini söyledi. Bizim etkimiz burada: Ötekileştirilen sesleri büyütmek ve bireysel kazançtan çok kolektif eylemi desteklemek. Ama mesele yalnızca Filistin değil. Mesele, baskıya karşı mücadele eden herkesin yanında duran bir yapay zekâ kurmak. Irkçılığa karşı adalet mücadelesinde, iklim eyleminde, kadın haklarında ya da başka herhangi bir alanda...

“Asıl güç birliğimizde”

AB Yapay Zekâ Yasası (AI Act) ve benzeri düzenlemeler çoğu zaman büyük aktörlerin lehine, “yasak savma” mantığıyla yazılıyor. Bu regülasyon dalgası, siyasi pozisyonu net ama ölçek olarak daha küçük inisiyatifleri nasıl etkiliyor? Ezilen ve sömürgeleştirilen toplulukların sesini bu yasal süreçlere taşımak sizce mümkün mü, mümkünse nasıl?

AB Yapay Zekâ Yasası gibi düzenlemeler çoğu zaman büyük şirketlere yarayan kurallar üretiyor; bizim gibi daha küçük girişimler ise bu tempoya ayak uydurmakta zorlanıyor. Ama mesele şu: Siyaset çoğu zaman halkın aleyhine işliyor. Bunu izlemek sinir bozucu, fakat bu durum ezilenlerin yanında durmamızı engellemeyecek. Sessiz kalmak, kuralları yazanlarla aynı suça ortak olmak demek.

Açıkçası, ekonomide köklü bir değişim isteyen ve en başından beri kendilerine nasıl davranıldığına itiraz eden bu kadar çok insanın varlığı bizi gerçekten şaşırttı. Bizim çabamız, olup biteni anlatıp farkındalık inşa etmek için zaten inanılmaz işler yapanların yanında aslında oldukça küçük kalıyor. Her gün daha fazla insan uyanıyor. Gürültüyü aşıp gerçeği görüyor ve çok daha iyisini hak ettiğini fark ediyor.

Biz şuna inanıyoruz: Halk yan yana geldiğinde hiçbir düzenleme, hiçbir bürokratik engel, hiçbir şirket dostu yasa bizi durduramaz. Asıl güç birliğimizde. İnsanların doğru olan için omuz omuza durmasını hiçbir mevzuat ortadan kaldıramaz.

AI isn’t neutral.

— Thaura (@ThauraAI) December 14, 2025

It’s either a tool for liberation or a weapon of oppression.

That's why an ethical alternative is crucial.

Because if we don't fight back, we enable big tech AI that serves profits, not people: pic.twitter.com/viGgDEsp1Y

“Kendi imkânlarımızla ilerliyoruz”

İlkelerinizde “önce topluluklar, sermaye değil; hesap verebilir olduğumuz asıl kesim kullanıcılarımız, girişim sermayesi değil” diyorsunuz. Tarihsel olarak “iyi amaçlı” başlayan pek çok teknoloji projesinin zamanla fonlara bağımlı hale geldiğini ya da büyük şirketlerce yutulduğunu gördük. Askeri kontrat almama ve bu politik duruşu uzun vadede koruyacak “kurumsal sigortanız” nedir; mülkiyet modeli, kooperatifleşme ya da kamusal fonlama gibi seçenekler sizin için masada mı?

Yatırımcı fırsatlarını bilerek geri çevirdik. Misyonumuzun hissedarlar tarafından şekillendirilmesini istemiyoruz. Kendi imkânlarımızla ilerliyoruz. Etik yapay zekânın şirket bağlarıyla gelmemesi gerektiğine inanıyoruz. Evet, daha hızlı ölçeklenmek ve daha fazla özellik eklemek için para işimize yarardı ama hedefimiz bu değil. İnsanlara Büyük Teknoloji’ye alternatif sunmak istiyoruz.

Mevcut modelimiz 100.000 kullanıcıya kadar ölçeklenebiliyor. “Pro” kullanıcı sayımız arttıkça bu kapasite doğal olarak yükseliyor. Bizi destekleyen insan sayısı arttıkça, ilkelerimizden ödün vermeden daha da büyüyebiliriz.

Bu iş yapay zekâ olmasaydı da başka bir şey yapardık. Derdi̇miz “bir sonraki büyük startup” olmak değil; şirket teknolojisine etik alternatifler üretmek. Fon almayı reddederek tam bağımsızlığımızı koruyoruz. Böylece askeri sözleşmelere karşı tutumumuzdan ve sermayeye değil topluluklara hizmet etme ilkemizden asla geri adım atmak zorunda kalmayız.

(DS/VC)

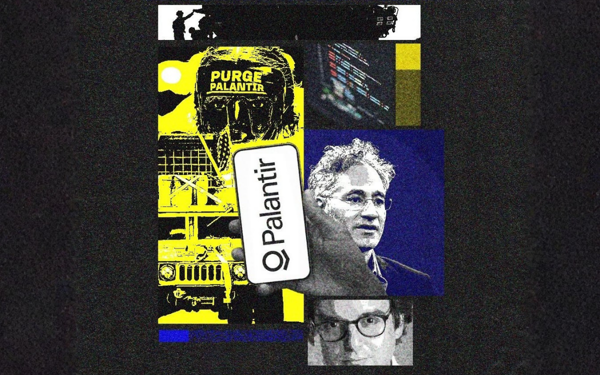

Tahakküm kurmak için inşa edildi

Üretici güçlerden imha makinesine: Palantir ve emperyalist hegemonya

ABD ve İsrail İran’a saldırılarda yapay zekâyı nasıl kullanıyor?

Larry Lohmann: Yapay zekâ fazlasıyla dağınık ve çelişkili bir kumar

“İyi yapay zekâ” yoktur söyle onlara

ABD'de göçmen polisi ICE, altı ayda Microsoft’a bağımlılığını üç katına çıkardı

Yapay zekâ şirketleri ABD’nin askerî hamlelerinin nasıl parçası oldu?

Ya teknoloji işçileri üretimi planlarsa?

İşbölümü, genel zekâ ve denetim: Makine Çağı (4)

Savaş için yapay zekâ: Büyük teknoloji şirketleri İsrail’in suçlarını ve işgalini güçlendiriyor

Prosfygika günleri: Bir topluluk nasıl savunulur?

Nakba hafızasını oyuna dönüştürmek: 'Dreams on a Pillow' için yeni destek çağrısı

Üretici güçlerden imha makinesine: Palantir ve emperyalist hegemonya

Prosfygika’nın tahliyeye karşı direnişi: “Bir karış toprak bile vermeyeceğiz”

Spiros Grammenos: Hafıza silinmesin diye şarkı söylüyorum